摘要:

DeepSeek与国产算力合力,实现token成本的大幅降低后,又会反向利好AI应用市场,催生更大的市场空间。

凤凰网科技 出品

作者|Dale、姜凡

编辑|董雨晴

两天两次降价,效率成了DeepSeek最深护城河

2026年4月的最后一个周末,中国AI产业被一连串消息彻底点燃,而消息背后的主角只有一个,DeepSeek。

4月24日,DeepSeek正式发布V4系列预览版,同步开源Pro与Flash两款模型,均支持百万token超长上下文。紧接着的25日与26日,DeepSeek连续两晚出手降价——先是V4-Pro限时2.5折,再是全系API输入缓存命中价格永久降至首发价的十分之一。两天两次调价之后,V4-Flash每百万tokens输入缓存命中价格仅为0.02元,V4-Pro为0.025元,创下全球大模型价格新低。

这样一场精心策划的闪电战,背后是DeepSeek长达一年的艰难求索。

但如果依旧将目光放在“价格战”的浅层叙事,就低估了DeepSeek此番出手的深意。V4的降价已经无关于烧钱换市场,其更大的意义是底层架构效率革命带来的成本变化。正如高盛Ronald Keung团队在最新研报中所指出的,“V4的核心意义在于以更低成本支持更复杂的智能体应用落地,从而打开AI应用规模化的新空间”。

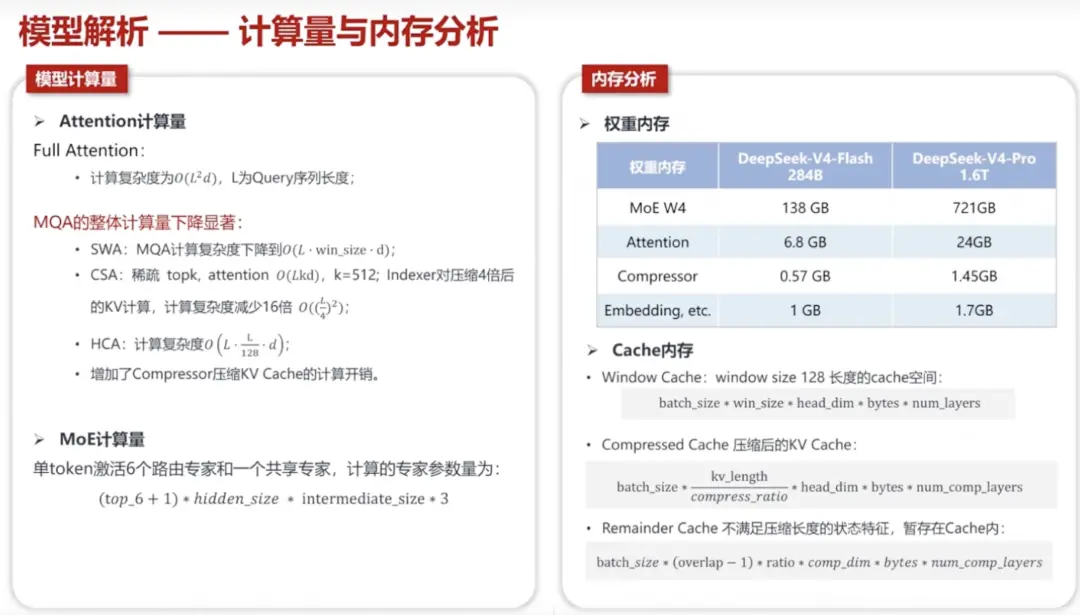

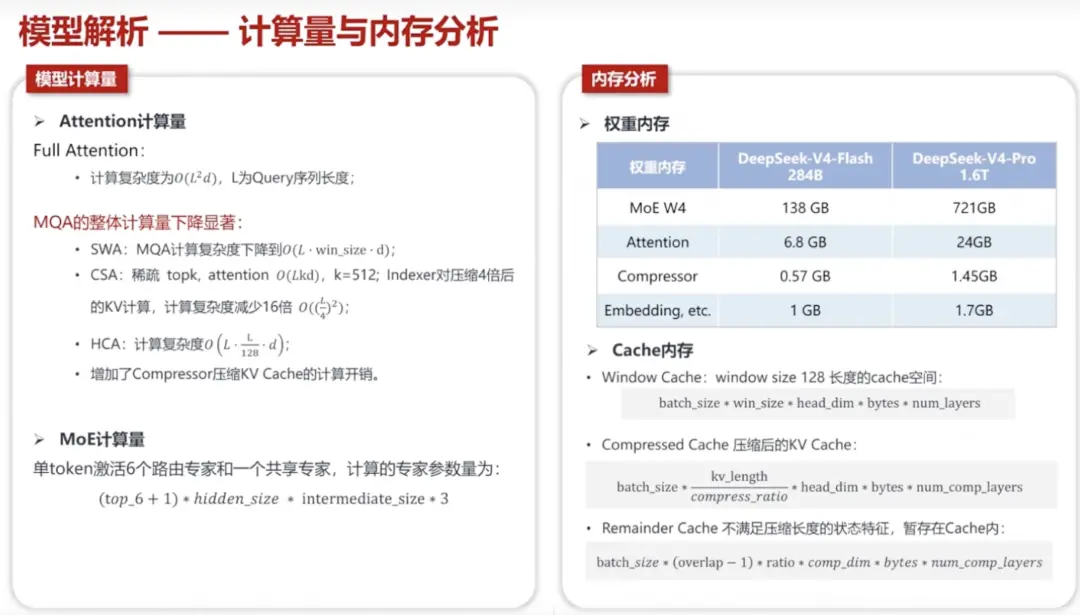

在DeepSeek-V4的技术报告里,效率是极致的。

V4-Pro在100万token上下文场景下,单token推理所需浮点运算量仅为V3.2的27%,KV缓存占用仅为10%;V4-Flash更为激进——FLOPs降至10%,KV缓存压缩至7%。这意味着什么?通俗地说,过去跑一条百万字上下文需要三台机器的算力,现在一台机器就能从容应对,而且内存开销仅是过去的十分之一。

效率飞跃背后,有V4在架构层面的三项关键创新:混合注意力机制(CSA/HCA)、流形约束超连接(mHC),以及Muon优化器。其中最核心的突破在于混合注意力——CSA(压缩稀疏注意力)沿序列维度压缩KV缓存后执行稀疏注意力计算,每m个token的KV缓存被压缩为一条记录;HCA(重度压缩注意力)则施加更激进的压缩策略,将m'个token的KV缓存合并为单条记录,但仍保留稠密注意力。这套组合拳在几乎不影响模型性能的前提下,将长上下文场景的计算与存储成本砍掉了一个数量级。

更精妙的设计体现在细节处:对KV条目采用混合存储格式,旋转位置编码维度保持BF16精度,其余维度使用FP8精度,这一项便将KV缓存容量压缩近半。闪电索引器内部的注意力计算以FP4精度执行,进一步加速长上下文下的注意力运算。

技术压缩效率,效率兑现成本。这才是DeepSeek敢于连续降价的真正底牌。

理解了这一逻辑,便能看穿此次降价的产业含义:相比于其他AI大模型降价拼命上桌,这一次DeepSeek直接用技术优势主动构建了成本壁垒。V4-Flash以0.02元/百万tokens的价格横扫市场背后,每一分钱的降价都有底层架构优化作为支撑,而不是资本烧钱补贴的逻辑。竞争对手要跟进,首先得在技术上追平这份效率——而这显然不是一朝一夕之功。

从模型等芯片,到芯片靠模型

与两次降价几乎同步发生的,是国产芯片阵营的集体“起立”。

V4发布当日,华为昇腾、寒武纪、海光信息、摩尔线程、沐曦股份、昆仑芯、平头哥真武、天数智芯8家国产AI芯片品牌,以及英伟达,均宣布完成对DeepSeek-V4的适配。尤其值得注意的是,这是大模型产业首次实现“Day 0”级别的全栈适配:模型发布即适配上线,芯片厂商不再需要数月的“追逐式”调试周期。

这里有一个细节必须拆解清楚。DeepSeek官方在技术报告中表示,“我们在英伟达GPU和华为昇腾NPU两个平台上验证了细粒度EP(专家并行)方案,在通用推理任务中实现1.50至1.73倍加速;在延迟敏感场景下最高达到1.96倍”。这是DeepSeek历史上首次将国产芯片与英伟达GPU并列写入硬件验证清单,确立对等地位。

华为昇腾的反应也十分迅猛。昇腾官方在B站直播中称,在推理部署层面,昇腾950PR平台针对V4实现了多项深度适配。量化方面,原生的硬件加速精度明确支持MXFP8与MXFP4等低精度数据格式,兼顾模型精度与内存占用优化。算子层面,华为官方宣布昇腾950通过融合kernel与多流并行技术,大幅降低了混合注意力机制的计算和访存开销,显著提升了推理性能。而MoE模块中路由专家与共享专家的计算重叠等深度优化,则进一步确保了万亿参数模型在国产硬件上的高效平稳运行。

图|昇腾直播间截图

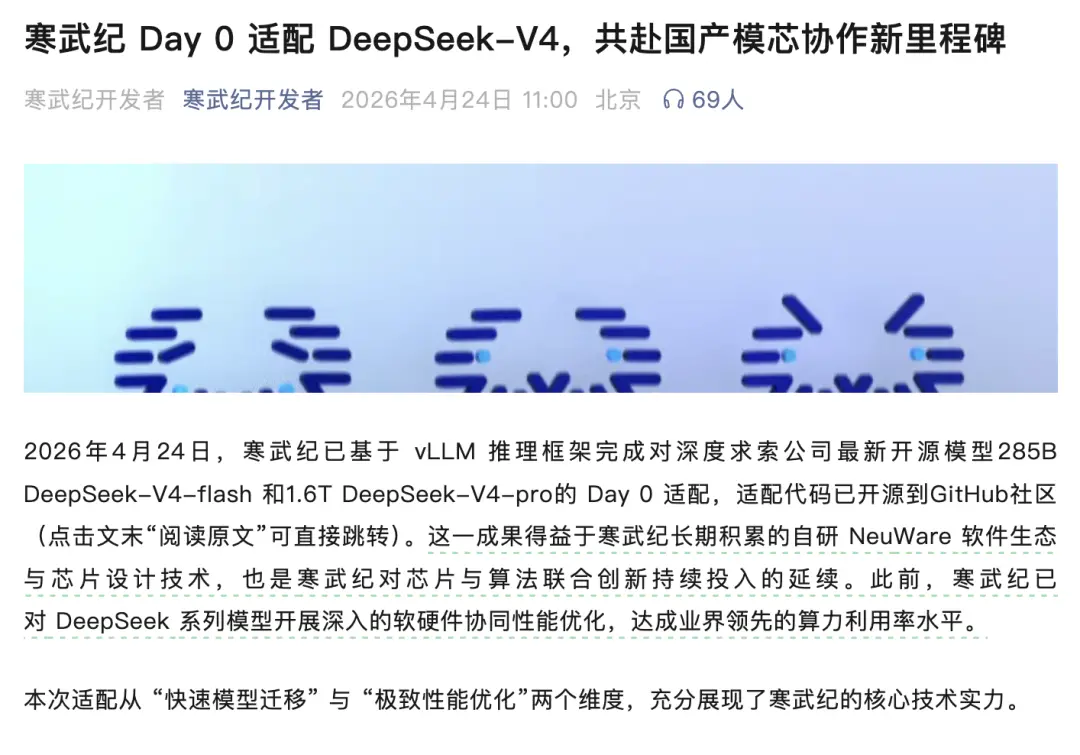

寒武纪则在基于自研NeuWare软件生态与vLLM框架上,完成了对V4的“Day 0”适配并同步开源自研算子库。这已是寒武纪连续第二次在DeepSeek新模型发布首日便推出适配方案,其技术迭代速度同样不容小觑。

更有说服力的信号来自财务上的持续好转,国产开源大模型的极速发展,正在把中国算力产业拉入良性发展的通道里。

4月26日晚,摩尔线程发布2026年一季报:一季度营业收入7.38亿元,同比增长155.35%;归母净利润2935.92万元,同比扭亏为盈。这家被称为“中国英伟达”的国产GPU厂商,此前因研发投入高达营收86.68%而备受市场质疑,如今终于交出了一份逆转的答卷。与此同时,摩尔线程还与某客户签订了金额达6.6亿元的夸娥智算集群销售合同。

寒武纪此前发布的年度业绩快报亦显示已率先实现盈利,沐曦股份则呈现出亏损持续收窄的态势。三家国产AI芯片代表企业同步进入业绩改善通道,已经是十分有力的回应。

国产算力生态临界点的到来

当DeepSeek的技术效率革命与国产芯片的产能释放在同一时间窗口交汇,一条完整的产业闭环开始浮出水面。

中银国际在4月26日发布的研报中判断:“DeepSeek V4的发布标志着国产大模型已基本跑通全栈国产化,理论上已形成从底层硬件、基础软件、平台服务到上层应用、安全体系的完整技术链条,国产算力板块或迎来自己的质变临界点。”

反过来看,DeepSeek与国产算力实现合力,在大幅降低token成本后,又会反向利好AI应用市场,催生更大的市场空间。

据华泰证券表述,“市场容易将V4理解为‘降本压低算力、存储需求’,但更重要的边际变化在于长上下文成本下降后,复杂Agent、多文档分析、长周期任务、在线学习等场景可用性提升,推理调用量与存储访问频次有望扩张。”换句话说,降价不会缩减蛋糕,还会做大蛋糕——越便宜用得越凶,总调用量反而会暴增。

同样在4月24日,新版本OpenClaw 发布,直接接入了最新的DeepSeek V4双版本,并将V4 Flash设置为了默认大模型。

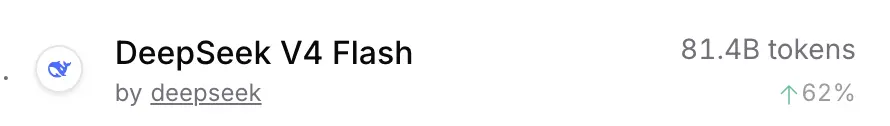

据OpenRouter平台数据,DeepSeek V4 flash今日调用量较前一天上涨了62%。

值得一提的是,DeepSeek已明确将华为昇腾950超节点量产纳入其商业路径,并预告下半年实现大规模供货后API定价将迎来显著下降。这意味着当前的降价可能只是一个预告,真正的主菜还在后面。

资本市场已作出热烈反应。4月27日早盘,A股算力芯片概念延续强势,CPU方向领涨,海光信息、摩尔线程等跟涨;港股半导体板块领涨,澜起科技涨超6%,中芯国际涨近5%。产业链上下游——从芯片设计到服务器整机,从算力租赁到AI应用——都在重新定价这一历史性的产业变局。

这个4月,DeepSeek以一组硬核效率数据为矛、以两次精准降价为鼓,打出明牌——AI的长上下文时代已经到来,而它的“高速公路”将由国产算力铺就。对那些刚刚登陆科创板的国产芯片企业而言,这个春天确实比往年都暖。